Tugas_DWDM

Transcript of Tugas_DWDM

Mata Kuliah : Data Warehouse and Data Mining

1. Jelaskan perbedaan antara Clustering dan Classification !

Jawab :

Clustering berbeda dengan Classification.

Clustering mengelompokkan data dengan karakteristik yang tidak harus sama

(berdasarkan pada kemiripan/kedekatan dari suatu karakteristik data) ke suatu

‘kelompok’ yang sama (sebelumnya belum terbentuk kelompok data yang pasti).

Sedangkan Classification mengklasifikasikan suatu data yang karakteristiknya

sama ke dalam kelompok yang sudah ada. (kelompok data sudah tersedia, tidak

ada pembentukan kelompok baru).

2. Berikan 2 contoh algoritma untuk Clustering. Jelaskan !

Jawab :

- Algoritma K-Means Clustering

1. Tentukan jumlah cluster

2. Partisi item menjadi K initial cluster

3. Hitung rata-rata setiap cluster dari data yang tergabung di dalamnya

4. Lakukan proses perhitungan dari daftar item, tandai item untuk kelompok

yang mana berdasarkan pusat (mean) yang terdekat (dengan menggunakan

distance dapat digunakan Euclidean distance). Hitung kembali pusat

centroid untuk item baru yang diterima pada cluster tersebut dari cluster

yang kehilangan item.

Rumus Ecluidean Distance :

5. Ulangi langkah 3 hingga tidak ada lagi tempat yang akan ditandai sebagai

cluster baru.

Contoh K-Means Clustering :

Diketahui :

ItemObservasi

X1 X2A 5 3B -1 1C 1 -2D -3 -2

Ditanya : Lakukan cluster menjadi 2 kelompok (K = 2).

Jawab :

1. K = 2

2. Mempartisi item menjadi K = 2

3. Menghitung rata-rata setiap cluster

ClusterKoordinate dari Centroid

(AB)

(CD)

4. Melakukan proses perhitungan dari daftar item.

Melakukan perhitungan jarak dengan Eclidean dari masing-masing item

dari centroid (pusat) cluster dan tandai kembali setiap item berdasarkan

kedekatan group. Jika item bergerak dari initial configuration, Centroid

(pusat/means) cluster harus diupdate sebelum diproses. Menghitung

kuadrat jarak (squared distance) sbb:

A dekat pada cluster (AB) dibandingkan pada cluster (CD), maka tidak

perlu ditandai. Perhitungan selanjutnya :

B akan ditandai kembali menjadi anggota baru pada cluster (CD), sehingga

membentuk cluster baru (BCD) maka koordinat dari pusat cluster

terupdate sebagai berikut :

ClusterKoordinate dari Centroid

A 5 3(BCD) -1 -1

Selanjutnya melakukan cek untuk setiap item untuk ditandai kembali.

Perhitungan kuadrat jarak (squared distances) diberikan sbb:

ClusterKoordinate dari Centroid

A B C DA 0 40 41 89

(BCD) 52 4 5 5

Karena setiap item yang baru telah ditandai untuk cluster berdasarkan

centroid (pusat) terdekat, maka proses telah dihentikan. Sehingga dengan

K = 2 cluster maka terbentuk cluster sebagai berikut : A dan (BCD).

- Algoritma K-Medoids

Dalam metode k-medoid ini setiap cluster dipresentasikan dari sebuah objek

di dalam cluster yang disebut dengan medoid. Clusternya dibangun dari hasil

mencocokkan setiap objek data yang paling dekat dengan cluster yang

dianggap sebagai medoid sementara.

1. pilih point k sebagai inisial centroid / nilai tengah (medoids) sebanyak k

cluster.

2. cari semua point yang paling dekat dengan medoid, dengan cara

menghitung jarak vector antar dokumen. (menggunakan Euclidian

distance)

3. secara random, pilih point yang bukan medoid.

4. hitung total distance

5. if TD baru < TD awal, tukar posisi medoid dengan medoids baru, jadilah

medoid yang baru.

6. ulangi langkah 2 - 5 sampai medoid tidak berubah.

Contoh K-Medoids :

X1 2 6X2 3 4X3 3 8

X4 4 7X5 5 2X6 5 4X7 7 3X8 7 4X9 8 5X10 7 6

K = 2, c1 (3,4); c2 (7,4)

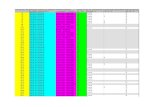

c1 Data Object(Xi) Cost Distance3.4 2 63.4 3 83.4 4 73.4 6 23.4 6 43.4 7 33.4 8 53.4 7 6

C2 Data Object(Xi) Cost Distance7.4 2 67.4 3 87.4 4 77.4 6 27.4 6 47.4 7 37.4 8 57.4 7 6

3. Berikan 2 contoh algoritma untuk Classification. Jelaskan !

Jawab :

- Naïve Bayes

Naïve Bayes adalah metode klasifikasi yang berdasarkan probabilitas dan

teorema Bayesian dengan asumsi bahwa setiap variable bersifat bebas

(independence).

Contoh Naïve Bayes :

Diketahui :

Dokumen Kategori Fitur (Kemunculan)dokumen1 olahraga menang(2), bola(3), gol(2)dokumen2 politik partai(3), pemilu(2), capres(4)dokumen3 ? partai(2), menang(1), tandang(2)

Ditanya : Kategori untuk dokumen3 ?

Jawab :

1. Term document matrix yang terbentuk dari data :

bola capres gol menang partai pemilu tandangdokumen1 3 0 2 2 0 0 0dokumen2 0 4 0 0 3 2 0dokumen3 0 0 0 1 2 0 2

2. Membuat model probabilistic dengan perhitungan :

Ket :

adalah nilai kemunculan kata pada kategori

adalah jumlah keseluruhan kata pada kategori

adalah jumlah keseluruhan kata/fitur yang digunakan

dan

Ket :

adalah jumlah dokumen yang memiliki kategori

adalah jumlah seluruh training dokumen

Model probabilistik yang terbentuk :

Kategoribola capres Gol menang partai pemilu tandang

olahraga

politik

3. Menentuan kategori dokumen3 :

p(“olahraga”|”dokumen3”) = p(“olahraga”) x p(“partai”|”olahraga”) x

p(“menang”|”olahraga”) x p(“tandang

“|”olahraga”)

=

=

p(“politik”|”dokumen3”) = p(“politik”) x p(“partai”|”politik”) x

p(“menang”|”politik”) x p(“tandang

“|”politik”)

=

=

Karena p(“politik”|”dokumen3”) > p(“olahraga”|”dokumen3”), maka

kategori dari dokumen3 adalah politik.

- Decision Tree (Algoritma C4.5)

Decision Tree adalah model prediksi menggunakan struktur pohon atau

struktur berhirarki.

1. Pilih atribut sebagai akar dengan didasarkan pada nilai gain tertinggi dari

atribut-atribut yang ada. Untuk menghitung gain digunakan rumus :

…… (1)

Ket :

S : Himpunan kasus

A : Atribut

N : Jumlah partisi atribut A

|Si| : Jumlah kasus pada partisi ke i

|S| : Jumlah kasus dalam S

Sedangkan perhitungan nilai entropy dapat dilihat pada rumus 2 berikut :

…… (2)

Ket :

S : Himpunan Kasus

p : Proporsi terhadap S

(+) : instance positif

(-) : instance negatif

2. Buat cabang untuk masing-masing nilai.

3. Bagi kasus dalam cabang.

4. Ulangi proses untuk masing-masing cabang sampai semua kasus pada

cabang memiliki kelas yang sama.

Contoh Decision Tree :

Diketahui :

No. Outlook Temperature Humidity Windy Play1. Sunny Hot High False No2. Sunny Hot High True No3. Cloudy Hot High False Yes4. Rainy Mild High False Yes5. Rainy Cool Normal False Yes

6. Rainy Cool Normal True Yes7. Cloudy Cool Normal True Yes8. Sunny Mild High False No9. Sunny Cool Normal False Yes10. Rainy Mild Normal False Yes11. Sunny Mild Normal True Yes12. Cloudy Mild High True Yes13. Cloudy Hot Normal False Yes14. Rainy Mild High True No

Ditanya : Keputusan bermain tenis (Ya / Tidak ) ?

Jawab :

a. Menghitung jumlah kasus, jumlah kasus untuk keputusan Yes, jumlah

kasus untuk keputusan No, dan Entropy dari semua kasus dan kasus yang

dibagi berdasarkan atribut OUTLOOK, TEMPERATURE, HUMIDITY

dan WINDY. Setelah itu lakukan penghitungan Gain untuk masingmasing

atribut. Hasil perhitungan ditunjukkan oleh Tabel 2.

Node JUMLAH KASUS (S)

NO(S1) YES(S2) ENTROPY GAIN

1 TOTAL 14 4 10 0.863120569

OUTLOOK 0.258521037CLOUDY 4 0 4 0RAINY 5 1 4 0.72192809

5SUNNY 5 3 2 0.97095059

4TEMPERATURE

0.183850925

COOL 4 0 4 0HOT 4 2 2 1MILD 6 2 4 0.91829583

4HUMIDITY 0.370506501

HIGH 7 4 3 0.985228136

NORMAL

7 0 7 0

WINDY 0.005977711FALSE 8 2 6 0.81127812

4TRUE 6 4 2 0.91829583

4

Baris TOTAL kolom Entropy pada table 2 dihitung dengan rumus 2,

sebagai berikut :

Sedangkan nilai Gain pada baris OUTLOOK dihitung dengan

menggunakan rumus 1

Sehingga didapat Gain(Total, Outlook) = 0.258521037

Dari hasil pada Tabel 2 dapat diketahui bahwa atribut dengan Gain

tertinggi adalah HUMIDITY yaitu sebesar 0.37. Dengan demikian

HUMIDITY dapat menjadi node akar. Ada 2 nilai atribut dari HUMIDITY

yaitu HIGH dan NORMAL. Dari kedua nilai atribut tersebut, nilai atribut

NORMAL sudah mengklasifikasikan kasus menjadi 1 yaitu keputusan-nya

Yes, sehingga tidak perlu dilakukan perhitungan lebih lanjut, tetapi untuk

nilai atribut HIGH masih perlu dilakukan perhitungan lagi.

Dari hasil tersebut dapat digambarkan pohon keputusan sementara seperti

Gambar 2.

b. Menghitung jumlah kasus, jumlah kasus untuk keputusan Yes, jumlah

kasus untuk keputusan No, dan Entropy dari semua kasus dan kasus yang

dibagi berdasarkan atribut OUTLOOK, TEMPERATURE dan WINDY

yang dapat menjadi node akar dari nilai atribut HIGH. Setelah itu lakukan

penghitungan Gain untuk masing-masing atribut. Hasil perhitungan

ditunjukkan oleh Tabel 3.

NodeJUMLAH KASUS

(S)NO(S1) YES(S2) ENTROPY GAIN

1.1 HUMIDITY HIGH

7 4 3 0.985228136

OUTLOOK 0.69951386CLOUDY 2 0 2 0RAINY 2 1 1 1SUNNY 3 3 0 0

TEMPERATURE

0.02024207

COOL 0 0 0 0HOT 3 2 1 0.918295834MILD 4 2 2 0.918295834

WINDY 0.020244207FALSE 4 2 2 1TRUE 3 2 1 0.918295834

Dari hasil pada Tabel 3 dapat diketahui bahwa atribut dengan Gain

tertinggi adalah OUTLOOK yaitu sebesar 0.67. Dengan demikian

OUTLOOK dapat menjadi node cabang dari nilai atribut HIGH. Ada 3

nilai atribut dari OUTLOOK yaitu CLOUDY, RAINY dan SUNNY. Dari

ketiga nilai atribut tersebut, nilai atribut CLOUDY sudah

mengklasifikasikan kasus menjadi 1 yaitu keputusan-nya Yes dan nilai

atribut SUNNY sudah mengklasifikasikan kasus menjadi satu dengan

keputusan No, sehingga tidak perlu dilakukan perhitungan lebih lanjut,

tetapi untuk nilai atribut RAINY masih perlu dilakukan perhitungan lagi.

Pohon keputusan yang terbentuk sampai tahap ini ditunjukkan pada

gambar 3.

c. Menghitung jumlah kasus, jumlah kasus untuk keputusan Yes, jumlah

kasus untuk keputusan No, dan Entropy dari semua kasus dan kasus yang

dibagi berdasarkan atribut TEMPERATURE dan WINDY yang dapat

menjadi node cabang dari nilai atribut RAINY. Setelah itu lakukan

penghitungan Gain untuk masing-masing atribut. Hasil perhitungan

ditunjukkan oleh Tabel 4.

NodeJUMLAH KASUS

(S)NO(S1) YES(S2) ENTROPY GAIN

1.1.2 HUMIDITY HIGH DAN OUTLOOK RAINY

2 1 1 1

TEMPERATURE 0COOL 0 0 0 0HOT 0 0 1 0MILD 2 1 1 1

WINDY 1FALSE 1 0 1 0TRUE 1 1 0 0

Dari hasil pada tabel 4 dapat diketahui bahwa atribut dengan Gain tertinggi

adalah WINDY yaitu sebesar 1. Dengan demikian WINDY dapat menjadi

node cabang dari nilai atribut RAINY. Ada 2 nilai atribut dari WINDY

yaitu FALSE dan TRUE. Dari kedua nilai atribut tersebut, nilai atribut

FALSE sudah mengklasifikasikan kasus menjadi 1 yaitu keputusan-nya

Yes dan nilai atribut TRUE sudah mengklasifikasikan kasus menjadi satu

dengan keputusan No, sehingga tidak perlu dilakukan perhitungan lebih

lanjut untuk nilai atribut ini.

Dengan memperhatikan pohon keputusan pada Gambar 4, diketahui bahwa

semua kasus sudah masuk dalam kelas. Dengan demikian, pohon

keputusan pada Gambar 4 merupakan pohon keputusan terakhir yang

terbentuk.